Hannover Messe 2024

Lösungen für leistungsfähige und vertrauenswürdige Künstliche Intelligenz

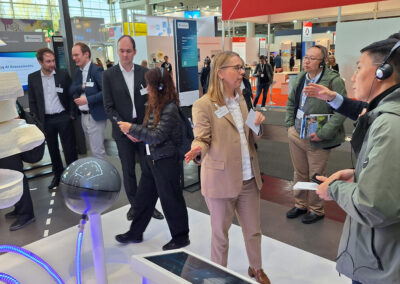

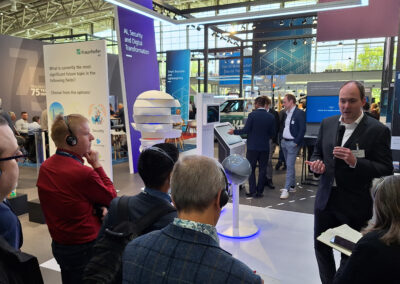

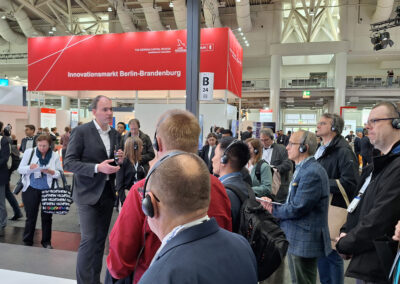

Auf dem Fraunhofer-Stand in Halle 2, Stand B24, konnten sich Fachbesucherinnen und Fachbesucher vom 22. bis 26. April 2024 anhand konkreter Use Cases und Lösungen aus dem Forschungsprojekt für vertrauenswürdige KI informieren und von unseren Projektexpertinnen und -experten persönlich erfahren, wie sie diese sicher in ihre Betriebsabläufe integrieren können.

KI besitzt großes Potenzial für die industrielle Produktion, beispielsweise für die Automatisierung, die Qualitätsprüfung oder die Optimierung von Prozessen: »Wir erhalten aktuell viele Anfragen von Unternehmen, die KI-Prototypen entwickelt haben und diese in die Serienproduktion bringen wollen. Damit die Skalierung gelingt, müssen diese KI-Lösungen systematisch getestet werden, um auch Schwachstellen erkennen zu können, die im Prototypen nicht zu Tage getreten sind«, erklärt Dr. Maximilian Poretschkin, Konsortialleiter des Forschungsprojektes ZERTIFIZIERTE KI.

Demonstratoren

»KI-Zuverlässigkeit für die Produktion«

Das Exponat bietet einen umfassenden Einblick in die Methoden und Best Practices zum Testen und zur Qualitätssicherung von KI-Anwendungen in der industriellen Produktion: Ein systematisches Vorgehen in Kombination mit KI-Prüftools hilft dabei, Schwächen von KI-Modellen ausfindig zu machen. Ein Prüfwerkzeug für KI-Modelle, das in der Produktion sowie im Maschinen- und Anlagenbau eingesetzt werden kann, ermöglicht die systematische Schwachstellensuche von KI-Systemen, um so deren Zuverlässigkeit und Robustheit sicherzustellen.

Anhand von drei Anwendungsfällen – Soft-Sensoren, automatische Qualitätsprüfung und große KI-Sprachmodelle zur Produktionsunterstützung – stellen wir Testwerkzeuge vor, die helfen potenzielle Fehler und Risiken in KI-Anwendungen frühzeitig zu erkennen und zu beseitigen. Unternehmen erhalten praxisorientierte Tools und Publikationen, die sie befähigen, KI-Systeme leistungsfähig und vertrauenswürdig zu gestalten. Das jüngste Whitepaper aus dem Projekt beschäftigt sich beispielsweise mit der Frage, wie mit Generativer KI und Foundation-Modellen entwickelte KI-Anwendungen bewertet und gesichert werden können.

Vertrauenswürdige Künstliche Intelligenz

In immer mehr sicherheitsrelevanten Bereichen kommen KI-Systeme zum Einsatz: als Fahrerassistenz in autonomen Fahrzeugen oder bei medizinischen Diagnosen. Welche Entscheidungen überlassen wir schon KI-Algorithmen und welche sollten wir besser selbst treffen? Wie verlässlich und sicher sind diese Technologien, die wir zunehmend selbstverständlich verwenden?

Wer entscheidet? Mensch oder KI? Besucher*innen können hier ihr Wissen testen.

Das Fraunhofer-Exponat »Who’s deciding here?« zeigt in Form eines Spiels Beispiele, bei denen KI uns Menschen bereits gut unterstützen kann. Die große Herausforderung dabei ist, die Leistungsfähigkeit der KI gut einschätzen zu können. KI wird immer besser, aber ist noch nicht perfekt: Einige der dargestellten Beispiele zeigen deshalb auch typische Herausforderungen, die bei der Entwicklung und dem Einsatz von KI zu beachten sind.

Use Cases Vertrauenswürdige KI

Außerdem präsentieren die Institute der Fraunhofer-Allianz Big Data AI sechs konkrete Beispiele aus verschiedenen Anwendungsbereichen. Die verbindende Fragestellung aller Use Cases: Wie lässt sich KI-Technologie kontrolliert und sicher einsetzen? Die Beispiele reichen von Prüftools für die Industrie über den Umgang mit sensiblen Produktionsdaten im Maschinen- und Anlagenbau bis hin zu menschzentrierter KI, die die Akzeptanz von KI im Blick hat.